Чем опасны дубли страниц и как с ними бороться

Дубли страниц — их очень просто создать, не всегда просто удалить и точно невозможно переоценить их пагубное влияние на ваш проект. Чем же так плох дублированный контент и откуда он может появиться на сайте, даже если вы ничего такого не делали, да и вообще хотели исключительно как лучше? С этим детально и разберемся в этой статье.

Почему дубли страниц — это плохо?

Можно выделить пять причин того, почему дубли страниц несут вред вашему сайту.

Важно понимать, что поисковая машина — это бизнес. Как любой бизнес, поисковик не хочет тратить ресурсы впустую, поэтому для каждого сайта определяется краулинговый бюджет — то количество ресурсов, которое поисковая система готова потратить на сканирование и индексирование сайта.

Из этого вытекает первая причина избегать появления дублей на сайте: поисковик будет тратить краулинговый бюджет на них вместо того чтобы сканировать действительно важные страницы, например, посадочные.

Проблемы со сканированием приводят к проблемам с индексацией — это вторая причина избавляться от дублей. Если важная для вашего бизнеса страница не будет просканирована, она не попадет в индекс. И если ваш сайт небольшой и молодой, есть вероятность, что переобхода придется ждать довольно долго.

Третья причина — это возможная каннибализация ключевых слов или ситуация, когда разные страницы конкурируют за одни и те же поисковые запросы. Проведем такую аналогию: вы зашли в новый супермаркет и вдали справа видите вывеску «хлеб», а вдали слева, весьма неожиданно, видите точно такую же вывеску. У вас возникает логичный вопрос: где же на самом деле находится нужный товар и почему вам морочат голову? В случае страниц-дублей поисковику также будет сложно понять, какую из них нужно ранжировать. Поэтому не морочьте биты и байты поисковому боту 🙂

Стоит отметить, что причиной каннибализации могут быть не только дубли страниц. Эта проблема также может возникнуть из-за дублирующихся title или H1, использования одинаковых ключей в контенте, из-за внешних ссылок с ключевым словом в анкоре, ведущих на нецелевую страницу.

Четвертая причина — это внешние ссылки, которые вы можете получить на страницы-дубли в ущерб основным страницам. Это может усилить эффект каннибализации, но не обязательно. Мы рассмотрим это вопрос подробнее ниже.

Пятая причина — алгоритм Google Панда, который пессимизирует сайт, в том числе за дублированный контент.

Какие бывают дубли?

Полные дубли — это когда страницы полностью идентичны, то есть один и тот же контент доступен по двум URL-адресам. Например:

- не настроено главное зеркало сайта и страница доступна как https://site.com/ и https://www.site.com/

- страница доступна как с завершающим слешем (символ /), так и без — site.com/page/ и site.com/page

- страница доступна с символами в верхнем и нижнем регистре — site.com/PAGE и site.com/page

- страница доступна с указанием категории в URL-адресе и без — site.com/phone/iphone/ и site.com/iphone/

- страница доступна с приписками вида .html, .htm, .php, .aspx и без — https://site.com/page и https://site.com/page.php

- не обрабатывается последовательность слешей в конце или середине URL, например, https://site.com/page/ также доступен как https://site.com/page///////////// или https://site.com///page/

- добавление произвольных вложенностей или символов в URL-адрес, который не обрабатывается. Например, https://site.com/page/ доступен также как https://site.com/page/cat/ или https://site.com/page/*

- комбинирование описанных выше вариантов

Частичные дубли — это когда страницы созданы под одну и ту же потребность пользователя, призваны решать одну и ту же задачу, имеют общую семантику и как следствие конкурируют между собой, что приводит к каннибализации ключевых слов. Например:

- параметры сортировки вида site.com/phome/?price=min: в URL-адресе меняется отображение товаров на странице на основе сортировки по цене, что приводит к частичному дублированию контента

- версии для печати — по сути, копия страницы без дизайна

- дублирование блоков контента — например, вывод идентичного блока комментариев на группе страниц

Причины возникновения дублей на сайте

Ошибка контент-менеджера

Самая банальная ситуация —когда контент добавили на сайт дважды, то есть созданы одинаковые страницы. К счастью, таких ситуаций легко можно избежать.

Если у вас сайт с преимущественно текстовым наполнением, вам стоит вести контент-план, с помощью которого вы сможете следить за своими публикациями. В любом случае необходимо периодически делать ревизию контента и следить за посадочными страницами, чтобы избежать проблем с каннибализацией и дублями.

Если контент добавлен и проиндексирован, необходимо определить основную страницу и оставить только ее. Для этого воспользуйтесь инструкциями ниже в секции «Выбор основной версии страницы».

URL с параметрами

Чаще всего именно параметры становятся причиной дублирования контента и траты краулингового бюджета на страницы, не представляющие ценности.

Параметры и дубли страниц могут появляться при:

- использовании фильтров отображения контента на странице: списком, плиткой и т.д.

- фильтрации товаров

- использовании UTM-меток

- использовании параметров сортировки по цене, от дешевых к дорогим и т.д.

- неправильно работающей пагинации

- передаче другой технической информации через параметры URL

Классическим решением является использование тега canonical. В таком случае все страницы с параметрами указывают на страницу без параметров как на каноническую. Например: https://seranking.com/ru/?sort=desc содержит <link rel=”canonical” href=”https://seranking.com/ru/”/>.

Второй классический вариант решения проблемы — использование метатега robots либо X-Robots-Tag с директивой noindex для предотвращения индексации страниц.

В случае страниц с параметрами лично мне больше нравится решение с canonical. Но важно помнить, что canonical является для поисковиков только рекомендацией.

Для решения проблем фильтрации я рекомендую заменять теги <a> на <span> для тех фильтров, которые заведомо создают страницы-дубли или страницы, которые вы не планируете индексировать. Это более сложное решение, которое экономит краулинговый бюджет, но требует постановки задачи разработчику.

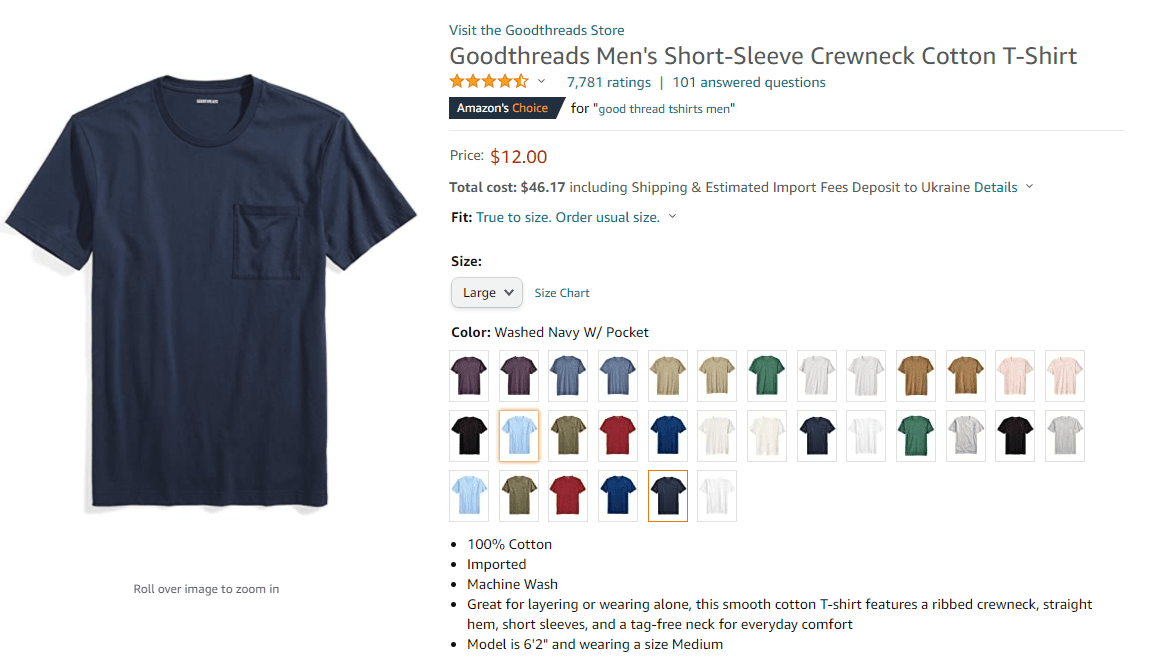

Однотипные товары с различными вариантами продукта

Я приверженец практики, когда для практически одинаковых товаров — например, футболок разных цветов — используют одну и ту же карточку товара, а нужный вам вариант можно выбрать при заказе. Таким образом минимизируется число дублей — карточек товара с одинаковым продуктом, а пользователь всегда попадает именно на тот товар, который он ищет. Такое решение также позволяет сэкономить краулинговый бюджет и избежать каннибализации.

Региональные версии сайтов

Иногда для региональных версий сайта интернет-магазина вместо поддоменов используются папки. В результате в каждой такой папке содержится один и тот же контент. По моему мнению, в таких ситуациях все же лучше использовать поддомены. Но можно также оптимизировать страницы таким образом, чтобы избегать дублирования.

Если вы все-таки используете папки для интернет-магазина, необходимо как минимум уникализировать Title и H1, а также перемешать вывод товаров таким образом, чтобы он отличался от других страниц. К сожалению, даже в таком случае нет гарантии, что поисковые роботы просканируют страницы корректно — возможно, вам придется провести дополнительные работы по уникализации.

Для сайтов услуг проблема решается проще. Если вы создаете страницы под разные города, пишите уникальный локальный контент для конкретной локации.

Использование hreflang помогает решить проблему с частичными дублями, но использовать этот инструмент нужно аккуратно и обязательно отслеживать ситуацию.

Последняя ситуация, которая встречается реже, — использование региональных доменов с одинаковым контентом, т.е. когда каждый регион\область\штат имеет свой сайт на отдельном домене, но при этом используют одинаковый либо похожий контент. В таком случае стоит, опять-таки, уникализировать контент с учетом особенностей каждой локации и правильно настроить теги hreflang.

Доступность товара в разных категориях

Зачастую в интернет-магазинах товар добавляют сразу в несколько категорий. Это может стать причиной дублирования, если URL содержит полный путь к товару, например:

https://site.com/t-shirt/nike/t-shirt-best.html и https://site.com/t-shirt/red/t-shirt-best.html

Эту проблему можно решить, исправив логику работы CMS, чтобы для товаров в разных категориях всегда использовался один URL. На мой взгляд, это оптимальное решение проблемы. Также можно использовать тег canonical.

Технические проблемы

Одна из самых популярных проблем дублирования — техническая. Особенно часто проблема встречается в самописных или малопопулярных CMS, но грешат этим и более именитые системы. Поэтому SEO-специалист всегда должен быть на чеку и контролировать параметры, которые приводят к дублированию: настроено ли главное зеркало, обрабатываются ли завершающие слеши и т.д. Полный список возможных технических проблем, из-за которых на сайте появляются полные дубли, я приводил выше.

Как предотвратить проблемы с дублированными страницами

На этапе создания сайта вы можете предотвратить сканирование нежелательных URL-адресов с помощью файла robots.txt. Только помните, что нужно быть осторожными и всегда проверять работоспособность правила с помощью инструмента Robots Testing Tool в Google Search Console. Так вы сможете избежать ситуации, когда файл robots.txt будет запрещать краулерам сканировать и индексировать нужные страницы.

Также следует запретить индексацию нежелательных страниц с помощью тега <meta name=”robots” content=”noindex”> либо с помощью X-Robots-Tag: noindex в ответе сервера. Это классические и самые простые способы.

Важно! Если поисковик уже нашел нежелательные страницы и, чтобы решить проблему, вы используете тег canonical или директиву noindex, запрет на сканирование в файле robots.txt нужно добавлять только после того, как робот просканирует страницы. В противном случае бот не обнаружит на страницах тег canonical или директиву noindex и проблема с дублями не будет решена.

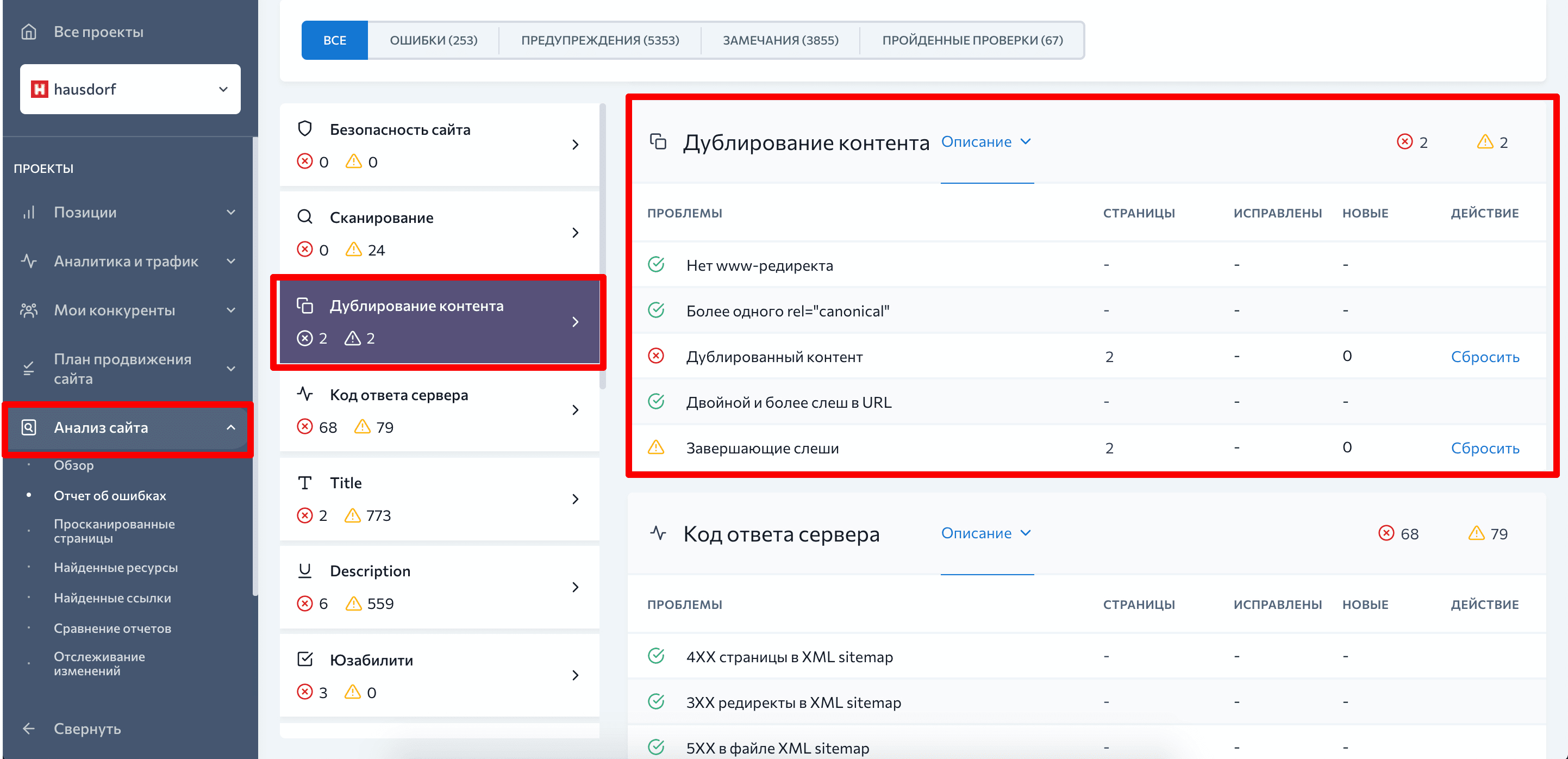

Как найти дубли страниц с помощью SE Ranking

Найти дубли страниц вам поможет инструмент «Аудит сайта». Здесь в разделе «Дублирование контента» вы найдете как список страниц, на которых используется одинаковый контент, так и список технических дублей — доступных с www и без, с завершающим слешем и без, с одинарным слешем и с двойным. Если для решения проблемы с дублями вы использовали тег canonical, но случайно указали несколько канонических URL-адресов, аудит укажет и на эту ошибку.

Выбор основной версии страницы

Если вы обнаружили на сайте дублированный контент, не спешите его удалять. Сперва нужно выполнить ряд проверок:

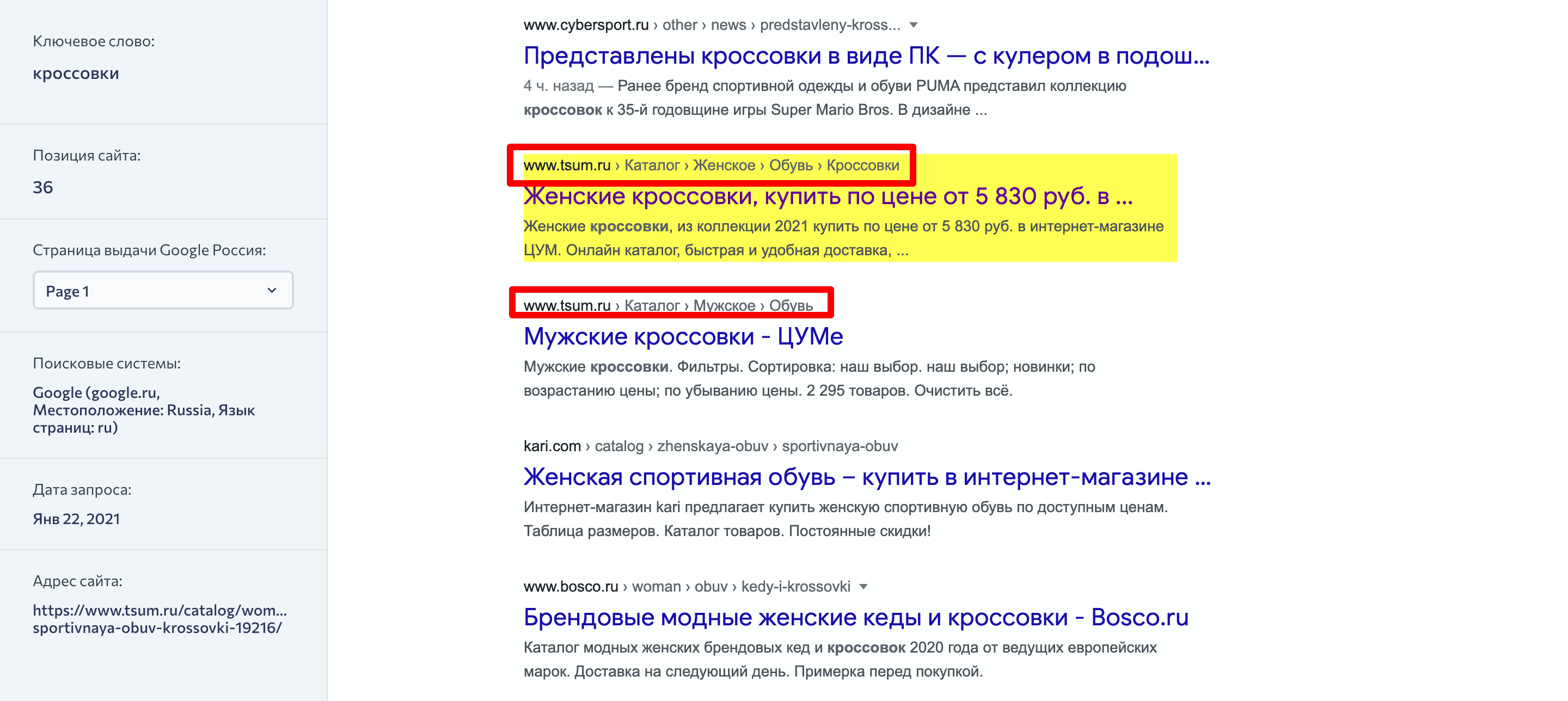

- Определите, какая страница лучше ранжируется в поисковике по ключу. Проверить это можно несколькими способами.

- Используйте оператор site:ваш-урл ключевое слово. Если на первом месте вы видите не одну из страниц-дублей, а совершенно другую — значит целевая страница плохо оптимизирована. Или, как вариант, вы просто использовали для поиска не тот ключ, под который заточены страницы-дубли. Если у вас нет составленного семантического ядра для конкретной страницы, правильный ключ вы можете подсмотреть в title страницы-дубля.

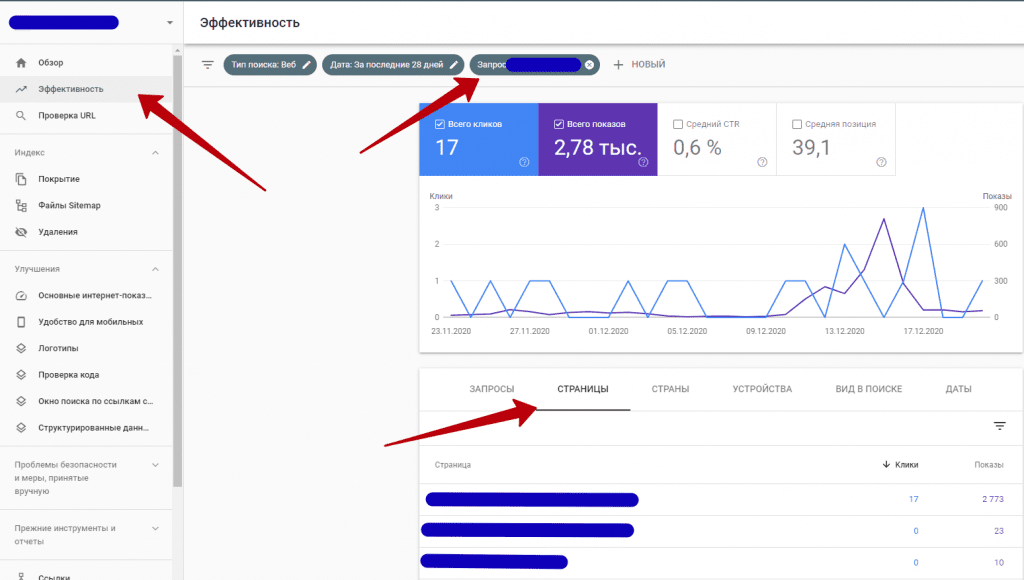

- Узнать, какие страницы показывают в выдаче по ключу, также можно с помощью Google Search Console. Для этого используйте отчет «Эффективность», в котором есть фильтр по ключу.

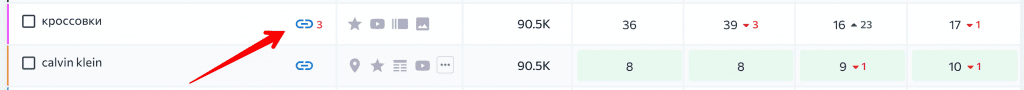

- Быстрее всего проверить, какая из страниц-дублей лучше ранжируется, можно при помощи модулей SE Ranking. В модуле «Позиции» у вас есть возможность указать для каждого ключа целевой URL-адрес. Если URL, который ранжируется по ключу, и целевой URL не будут совпадать, иконка рядом с ключевым словом будет красного цвета.

- Также вы сразу заметите, если URL-адреса в выдаче постоянно меняются — рядом с иконкой URL появится цифра с количеством страниц, которые конкурируют за место в выдаче. По клику на иконку вы увидите все адреса конкурирующих страниц и их title.

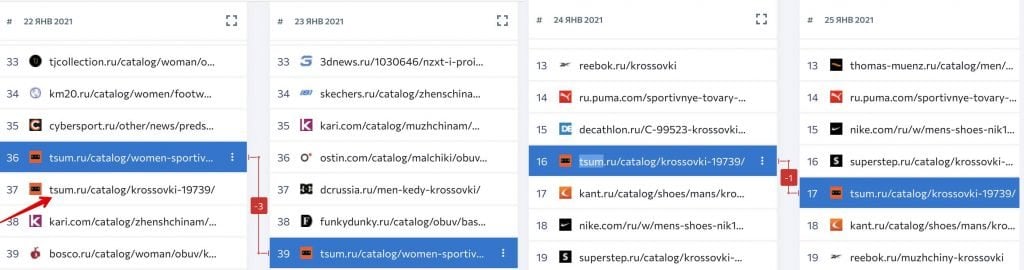

- Более наочно увидеть изменения URL в выдаче и вместе с ним позиции сайта можно в разделе «Мониторинг ТОП-100» модуля «Мои конкуренты». Если у сайта есть проблема с каннибилизацией, вы это сразу заметите.

- Дальше определите число внешних ссылок на каждую из страниц-дублей. Желательно оставить страницу, у которой бэклинков больше.

- Определите количество ключевых слов, по которым были показы страницы. Для этого снова можно использовать GSC, но отфильтровать данные по странице, а не по ключу, как ранее.

- Определите, сколько трафика получают страницы, какой показатель отказов и конверсий. Для этого вы можете использовать GA либо SE Ranking. Увидеть данные можно в разделе «Аналитика и трафик».

- На основе всех показателей решайте, какую страницу вы хотите оставить.

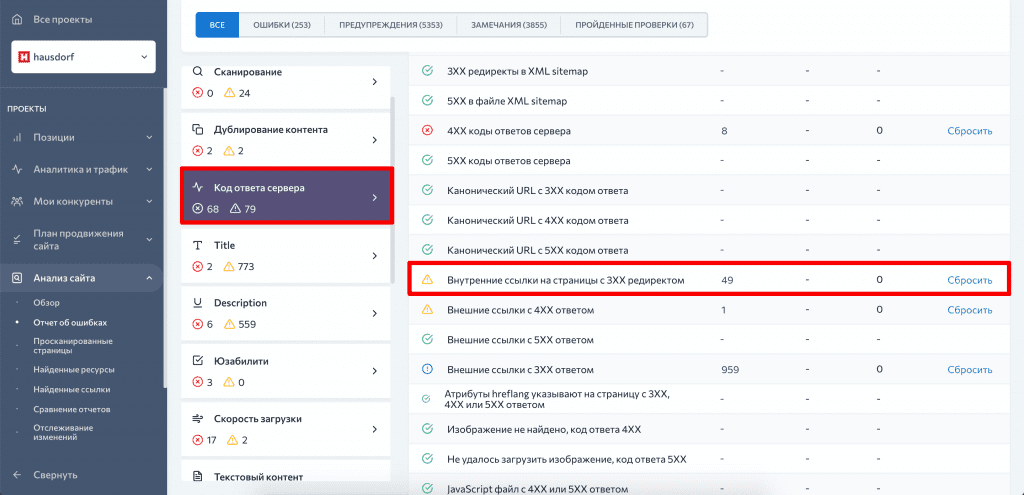

Удалив страницу-дубль, нужно настроить с нее 301 редирект на основную страницу. После этого рекомендуется еще раз просканировать сайт, чтобы найти внутренние ссылки на удаленную страницу — их нужно заменить на URL-адрес, который вы решили оставить. Список таких ссылок вы найдете в разделе «Код ответа сервера» отчета об ошибках «Анализа сайта».

Дублировать или нет — вот в чем нет вопроса

Думаю, совершенно очевидно, что дублирование страниц — это угроза для вашего сайта, недооценивать которую не стоит. Поняв принцип проблемы и ее возможные источники, вы с легкостью сможете контролировать появление дублей на всех этапах жизни сайта. Важно вовремя обнаружить проблему и быстро исправить ее, с чем вам помогут регулярные аудиты сайта, проставление целевых URL-адресов для ключевых слов и регулярный мониторинг позиций.

А вы сталкивались с проблемой дублирования страниц? Как вы ее решали? Поделитесь своим опытом в комментариях под этим постом.